AI真的是Future吗?

1、AI 确实是未来发展的重要方向,其影响力已超越电影营造的氛围,成为现实世界中推动技术、经济和社会变革的核心力量。以下从技术趋势、行业应用、社会影响三个层面展开分析:技术趋势:AI 正处于指数级发展阶段当前AI技术已突破实验室阶段,进入规模化应用期。

2、future AI时代(宽AI):future AI时代将是人工智能发展的终极目标。宽AI将具备人类般的通用认知能力,能够理解、学习和推理,能够在任何知识范围内提供高质量的答案。这种技术一旦实现,将彻底改变人类社会的发展模式,推动人类文明进入新的发展阶段。

3、“十四五”建设继续推进,高质量、现代化、智能化发展 近年来,人工智能在经济发展、社会进步、国际政治经济格局等方面已经产生重大而深远的影响。

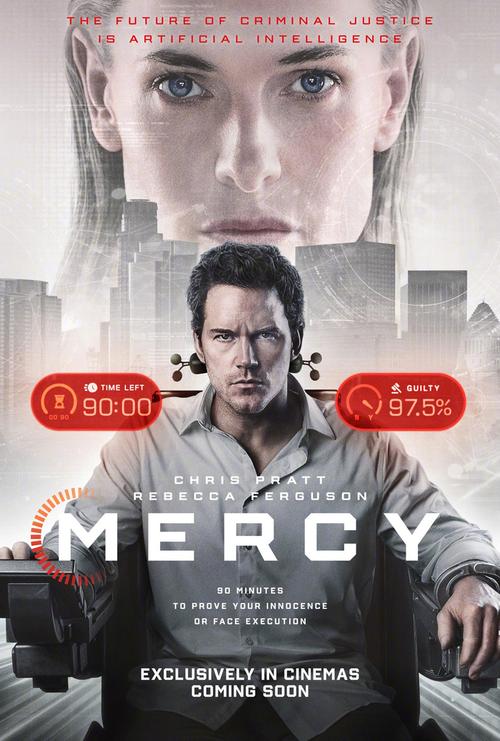

4、因此,需要高度逻辑推理、跨领域知识整合及实时交互反馈的工作,短期内难以被AI完全替代。现有研究数据中的岗位替代率参考牛津大学《The Future of Employment》论文对702种职业的替代率预测显示,“需要社交智慧、创造力或感知操作能力”的岗位被替代概率较低,而“可预期的重复性工作”风险较高。

5、future-proof等,都与预见或展望未来的发展或状况有关。这一词汇在各种语境中的应用广泛,可以根据具体语境理解其具体含义。例如,“AI的未来如何发展”这个话题就是在讨论人工智能未来的发展趋势和应用前景。因此,future这个词涵盖了多种对未来情景的探讨和预测,涉及到人们生活的方方面面。

如果一个ai模型在训练时使用了包含偏见的数据那么它在实际应用中会产生...

1、如果一个AI模型在训练时使用了包含偏见的数据,那么它在实际应用中最可能直接导致模型输出带有歧视性或不公平的结果。具体表现及影响如下: 系统性复制训练数据中的偏见训练数据中的隐含偏差(如性别、种族、年龄等维度的不平衡)会被模型直接学习并固化。

2、若AI模型在训练时使用了包含偏见的数据,在实际应用中会产生多方面负面影响。固化和放大社会偏见:模型会学习并强化训练数据中的历史偏见,如性别、种族、地域歧视等。这些偏见会通过自动化决策渗透到教育、就业、司法等关键领域,加剧社会不公,甚至固化弱势群体的边缘化地位。

3、偏见与歧视问题阐述:AI模型依赖大量数据进行训练,若训练数据本身存在偏见,模型就会继承这些偏见,进而在决策过程中产生不公平和歧视性的结果。例如,在招聘场景中,如果训练数据中某一性别或种族的求职者被不公平对待,那么基于该数据训练的AI模型可能会在筛选简历时对特定性别或种族产生歧视。

4、AI幻觉的产生原因过拟合:AI模型在训练过程中过于依赖训练数据,导致对新数据的泛化能力下降,从而产生幻觉。训练数据的偏见/不准确性:如果训练数据包含偏见或不准确的信息,AI模型可能会幻觉出反映这些偏见的模式或特征。模型复杂性过高:过于复杂的模型可能更容易受到噪声和异常数据的影响,从而产生幻觉。

5、模型泛化能力:尽管AI模型在训练数据上表现良好,但它们可能无法很好地泛化到新的、未见过的数据。这可能导致模型在实际应用中遇到问题时表现不稳定或不准确。数据训练与依赖 数据质量与偏见:AI系统的性能在很大程度上取决于训练数据的质量和多样性。

AI二阶效应:从前的“坏主意”变成了现在的“好生意”

1、在经济领域中,AI的二阶效应指的是AI技术的引入和广泛应用,不仅直接改变了经济系统的运作方式,还进一步影响了其他经济主体的选择和行为,产生了远超单个技术应用的广泛影响。这种影响往往表现为正向反馈,即AI技术的应用带来了经济结果的显著放大,使得一些原本看似不可行的商业模式或产品重新焕发生机。

人工智能伦理中,算法偏见主要源于什么

人工智能伦理中,算法偏见主要源于数据集不均衡、人工标注主观性、数据特征选择偏差以及算法设计与优化目标的选择。具体分析如下:数据集不均衡机器学习依赖的训练数据若存在群体或特征分布不均衡,算法会因数据代表性不足而产生偏见。

人工智能伦理中,算法偏见主要源于数据、特征选择、标签定义及算法设计等多方面因素。具体分析如下: 数据集不均衡机器学习依赖的数据集若在性别、种族、年龄等关键属性上存在代表性不足或失衡,模型会因学习样本偏差而产生偏见。

人工智能伦理中,算法偏见主要源于数据、算法设计、历史记录及标签定义等多个环节的缺陷,具体可分为以下方面:数据层面的偏见来源数据集不均衡训练数据若在性别、种族、年龄等关键属性上分布失衡,模型会因“样本偏见”产生系统性误差。

人工智能伦理中算法偏见主要源于数据集不均衡、人工标注主观性、数据特征选择偏差以及算法设计与优化目标四个方面。首先,机器学习采用的数据集不均衡是算法偏见的重要来源。当数据集在性别、种族、年龄、地域等关键属性上存在代表性不足或失衡时,模型在学习过程中就可能对这些属性产生偏见。

算法偏见的来源多种多样,可能与数据质量、算法设计、人类干预等多个因素有关。其中,训练数据的不完整或不代表性是导致算法偏见的主要原因之一。此外,人类在设计和使用算法时的决策和偏好也可能影响算法的输出结果。算法偏见可能导致严重的社会影响,如加剧社会不平等、损害公众对人工智能系统的信任等。

本文来自作者[zhyqymt]投稿,不代表聚恒号立场,如若转载,请注明出处:https://zhyqymt.cn/zshi/202601-5331.html

评论列表(3条)

我是聚恒号的签约作者“zhyqymt”

本文概览:AI真的是Future吗? 1、AI 确实是未来发展的重要方向,其影响力已超越电影营造的氛围,成为现实世界中推动技术、经济和社会变革的核心力量。以下从技术趋势、行业应用、社会影...

文章不错《AI法官的偏见放大效应(法官观点)》内容很有帮助